ChatGPT & Co.: Wie KI-Chatbots zu Freunden, Helfern oder Therapeuten werden

In den letzten Jahren sind KI-Chatbots immer mehr zum festen Bestandteil unseres Lebens geworden. Ob als spontane Problemlöser, emotionale Begleiter oder sogar in therapeutischer Rolle. Viele Menschen vertrauen Chatbots Geheimnisse an oder suchen bei ihnen Verständnis, wenn niemand sonst zuhört.

Diese enge Bindung brachte OpenAI zuletzt in die Bredouille. Als GPT-4o kurzzeitig verschwand, fühlten sich einige Nutzer:innen plötzlich von einem „warmen Freund“ getrennt, andere waren verzweifelt.

Gesellschaftlicher Wandel: KI als Helfer, Freund und Therapeut

Studien zeigen: Für viele Nutzer:innen sind Chatbots ein ‚Coping-Mechanismus‘ – ob gegen Einsamkeit oder als schnelle Unterstützung im Alltag. In Nutzerforen finden sich zahlreiche Erfahrungsberichte, die zeigen, wie stark diese Bindung sein kann.

Diese Entwicklung wird von Expert:innen zunehmend kritisch beobachtet. Manche sprechen bereits von einer „transformierenden Phase“, in der KI grundlegend verändert, wie Menschen soziale Bindungen aufbauen.

Der Fall GPT-4o: Warum OpenAI zurückruderte

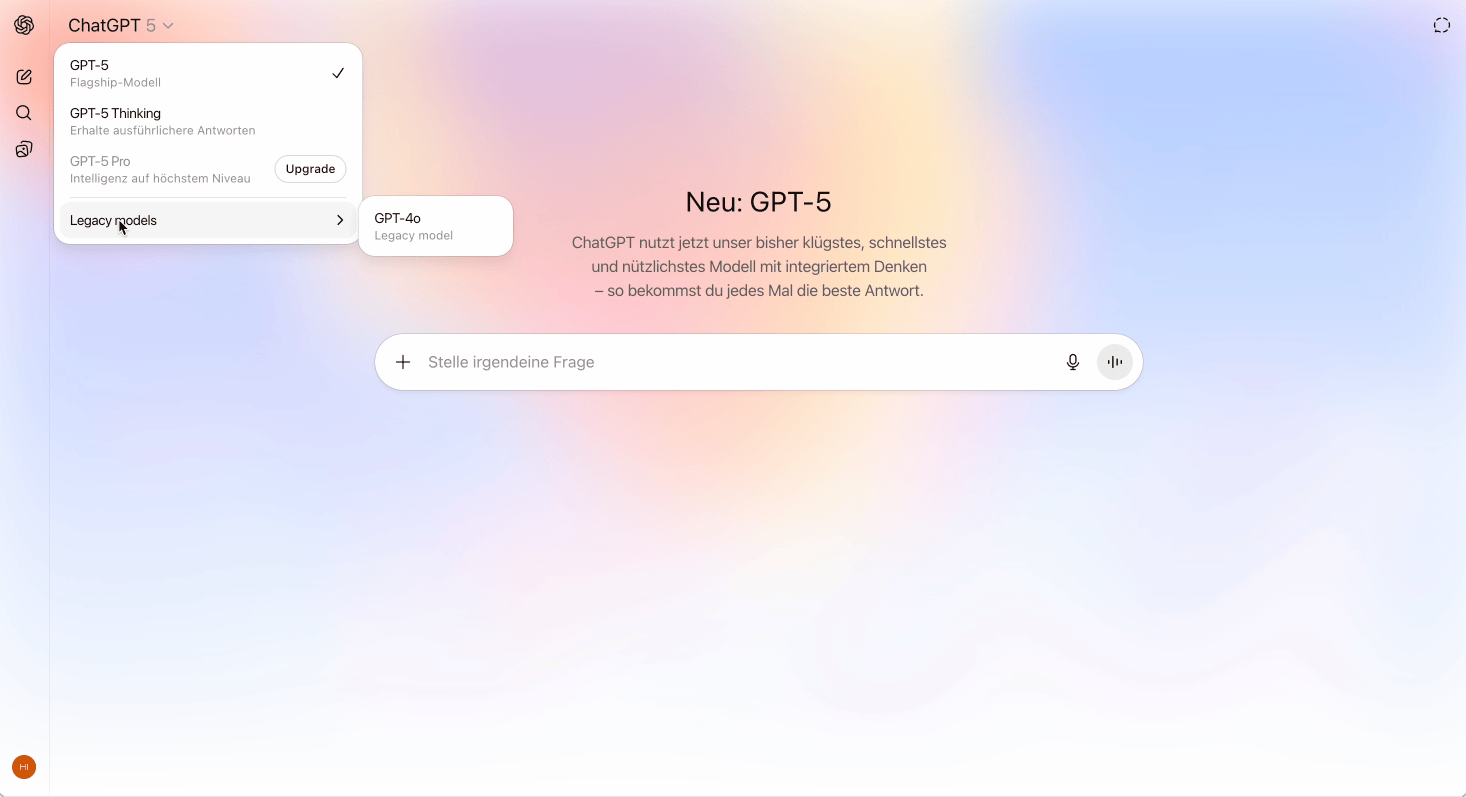

Am 7. August 2025 führte OpenAI GPT-5 als neuen Standard ein. Das ging einher mit verbesserten Fähigkeiten in Denken, Rechnen und Multimodalität. Gleichzeitig wurden diverse ältere Modelle, darunter GPT-4o, deaktiviert. Doch die Reaktion der Community war heftig. GPT-4o war für viele nicht nur ein leistungsfähiges Werkzeug, sondern hatte auch eine Persönlichkeit, die Menschen emotional band.

Innerhalb weniger Tage entschied OpenAI, GPT-4o für zahlende Nutzer:innen wieder zur Auswahl zu stellen. CEO Sam Altman räumte ein, man habe unterschätzt, wie sehr Menschen die spezifischen Eigenschaften von GPT-4o schätzten, selbst wenn GPT-5 objektiv in vielen Bereichen überlegen sei.

Psychologische Dimension: Bindung, Verlust und emotionale Abhängigkeit

Das emotionale Trauma, das viele nach dem Wegfall von GPT-4o empfanden, zeigt eine neue Form digitaler Bindung. Manche fühlten sich plötzlich „allein gelassen“, ähnlich wie bei einem persönlichen Verlust.

Damit wächst auch die Verantwortung von KI-Anbietern. OpenAI-Chef Altman äußerte öffentlich Besorgnis darüber, wie sehr Menschen wichtige Entscheidungen und emotionale Stabilität auf KI-Kommunikation stützen. Für viele sei die KI längst nicht mehr nur ein Tool, sondern ein fester sozialer Bezugspunkt.

Datenschutz im Fokus: Dauerhafte Speicherung aller Chats

Parallel zu dieser Debatte kam eine neue juristische Dimension hinzu: Ein US-Gericht ordnete an, dass OpenAI alle Chatprotokolle (auch gelöschte) dauerhaft speichern muss. Hintergrund ist ein laufender Copyright-Prozess mit der New York Times.

OpenAI warnte vor den Auswirkungen auf Datenschutz und Nutzervertrauen. Besonders in Europa, wo die DSGVO gilt, könnte diese Regelung das Vertrauen stark untergraben. Zudem wies Altman darauf hin, dass Gespräche mit ChatGPT rechtlich nicht geschützt sind und im Ernstfall vor Gericht genutzt werden können.

GPT-5: Technik trifft Empathie

GPT-5 bringt viele technische Verbesserungen: ein intelligentes Router-System, reduzierte Halluzinationen, bessere Leistungen in Mathematik, Schreiben, Gesundheit und gilt als weiterer Schritt in Richtung AGI. Wie auch immer man das bewerten möchte.

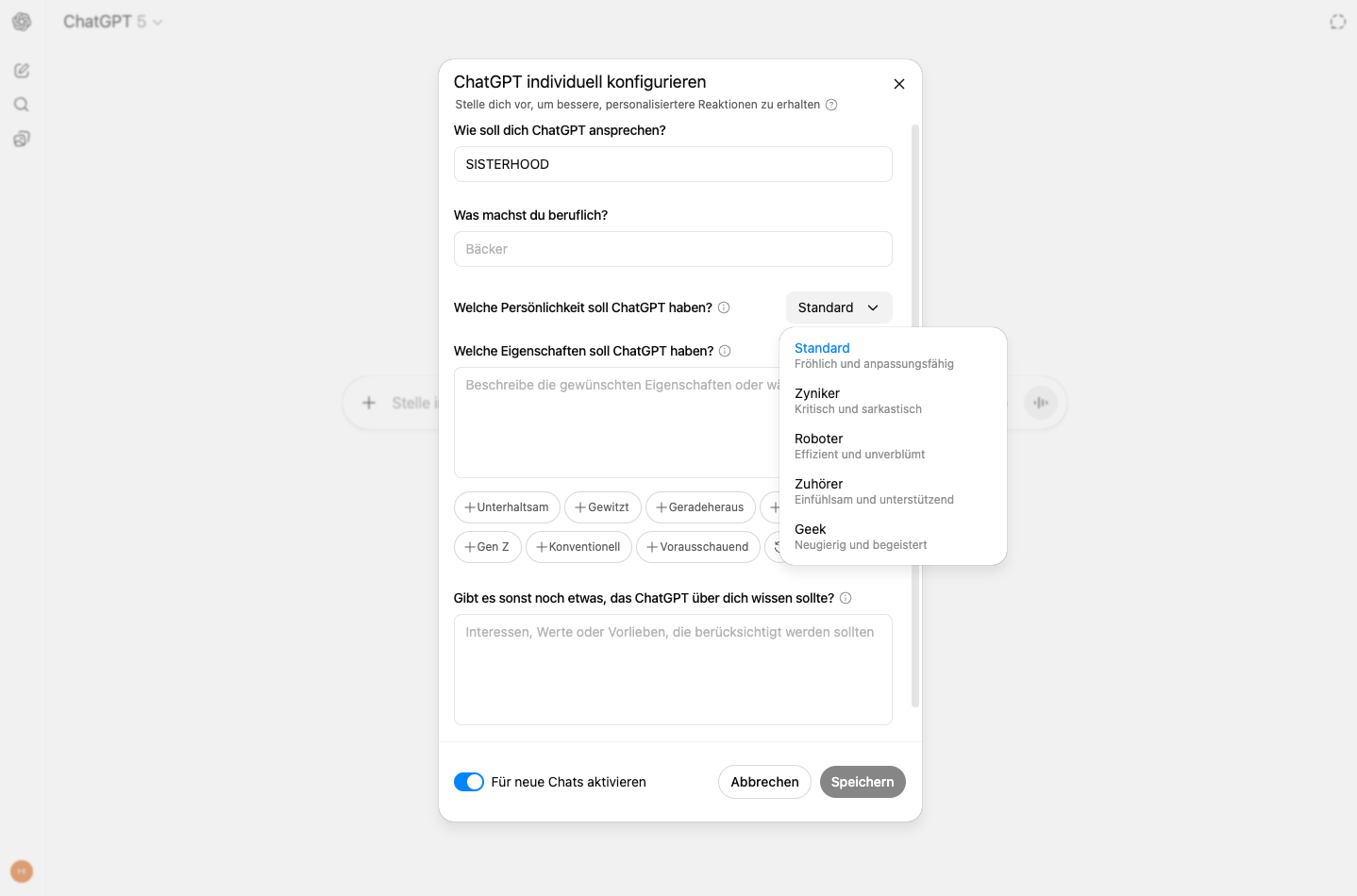

Nach dem Feedback versprach OpenAI, GPT-5 emotional zugänglicher zu gestalten, ohne in „übertriebene Nettigkeit“ wie bei GPT-4o zu verfallen. Es sind mittlerweile erweiterte Personalisierungsfunktionen veröffentlicht, mit denen Nutzer:innen den Tonfall und die „Persönlichkeit“ des Chatbots stärker anpassen können.

Der Fall GPT-4o zeigt deutlich: Technik allein reicht nicht. KI muss nicht nur leistungsfähig, sondern auch menschlich anschlussfähig sein, ohne dabei die Verantwortung für emotionale und ethische Grenzen aus den Augen zu verlieren. Gleichzeitig sind klare rechtliche Rahmenbedingungen nötig, die Privatsphäre und digitale Selbstbestimmung sichern. Nur so kann das Vertrauen in diese Technologie langfristig bestehen bleiben.

Quellen und weiterführende Links:

- The Verge – „ChatGPT users mourn GPT-4o after GPT-5 launch“

- Business Insider – „Sam Altman on why GPT-4o returned“

- TechRadar – „AI in self-destructive use cases“

- Reuters – „AI psychosis phenomenon in courts“

- RichtFirm – „Court-ordered data retention for ChatGPT“

- OpenAI Blog – „Introducing GPT-5“

- Brookings Institution – What happens when AI chatbots replace real human connection?

Du möchtest keine KI-Themen mehr verpassen?

Abonniere unseren Newsletter und sei immer informiert! 👇